Na sequência imediata de dois dos mais mortíferos tiroteios em massa na história moderna dos EUA, os americanos observam as conseqüências e se perguntam por quê. Perguntamos por que, e como podemos evitar que isso aconteça de novo?

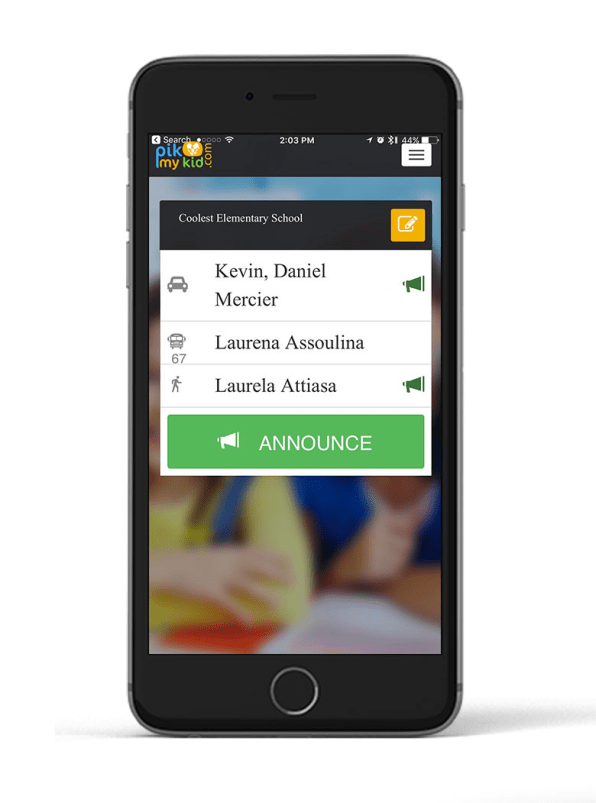

Em meio à inação em torno da política de armas ou saúde mental, um número crescente de escolas americanas está se voltando para a tecnologia para mitigar, e possivelmente impedir, tiroteios. Um dos números crescentes de empresas com o objetivo de satisfazer a demanda é o PikMyKid, um empreendedor de quatro anos, baseado em escola, baseado em escola, que vende um aplicativo que ajuda os pais e professores a rastrear os alunos durante e após os horários de recolha. No início deste ano, adicionou um novo recurso destinado a manter as crianças seguras durante emergências como um atirador ativo: um botão de pânico que permite que os funcionários da escola notifiquem rapidamente os primeiros atendentes da sua localização e enviem os planos dos prédios escolares.

Eventualmente, Pat Bhava, CEO e fundador da empresa, espera que o sistema possa até mesmo impedir os tiroteios. “Temos muito o que fazer”, disse ele.

Originalmente, o aplicativo estava focado em abordar o caos das demissões de fim de dia: ao mostrar onde os pais ou os cuidadores estão estacionados em uma linha de captação da escola, a empresa diz que pode encurtar o tempo necessário para pegar crianças e ajudar as escolas Certifique-se de que o garoto direito está entrando no carro certo. Bhava, que é indiano, disse ter a ideia depois da escola de sua filha “colocar uma garota branca no carro”.

À medida que a PikMyKid começou a administrar o fluxo de tráfego dentro e fora das escolas, ele ouviu uma nova demanda de clientes dos administradores escolares. “Eles precisavam diminuir o tempo de reação de quando ocorre um incidente quando os primeiros respondentes e toda a escola se aproximam de um plano de ação”, disse ele.

O novo recurso do aplicativo oferece aos professores e funcionários um botão de pânico: quando um empregado da escola detecta uma ameaça, pressiona um botão dentro do aplicativo PikMyKid. Uma vez que o alerta é disparado, as informações de localização em tempo real do dispositivo são enviadas para o 911 e para outros contatos importantes. O aplicativo também ativa o microfone do telefone, enviando um sinal de áudio contínuo para os atendentes de emergência. (As escolas pagam entre US $ 3.000 e US $ 4.000 por ano para operar o sistema, dependendo do tamanho da escola e outras opções, Bhava diz que está sendo usado em cerca de 110 escolas em 24 estados e 3 países diferentes.)

Como outros aplicativos que oferecem botões de pânico digital, incluindo Rave Mobile Safety e SchoolGuard, o PikMyKid também está adicionando suporte para mapas digitais que podem ser enviados para os primeiros respondentes para que eles não entrem em salas de aula ou corredores cegos durante uma emergência. Em julho, a startup assinou uma parceria com a FacilityONE, uma empresa que faz planos interativos e digitais. Atualmente, a maioria dos planos arquitetônicos das escolas não são digitalizados, mas sim mantidos como cópias impressas em tribunais ou arquivos municipais. Depois que a FacilityONE mapeia uma escola, o PikMyKid carrega o plano no perfil de segurança da escola. “À medida que [as primeiras respondentes estão] se aproximando de qualquer escola para qualquer emergência, eles são capazes de retirar esses planos diretamente do portal [PikMyKid]”, diz Bhava.

Um sistema de mapeamento semelhante para atendentes de emergência está sendo implementado em mais de 25 escolas secundárias em Ocean County, Califórnia, com um custo de cerca de US $ 800 por piso, o promotor do condado Joseph Coronato disse à USA Today em agosto. A empresa de planejamento de emergência Critical Response Group e a empresa de defesa e segurança BAE Systems, que fazem o sistema, dizem que também podem ser implantadas em tribunais, hospitais, usinas, locais de culto e parques temáticos.

As escolas também estão se voltando para o tipo de tecnologia de detecção de tiro atualmente em uso nas ruas de cidades como Nova York, Chicago e San Diego . Múltiplas empresas instalam e mantêm os sistemas, que usam sensores para triangular disparos e retransmitir informações para administradores e primeiros socorristas. Mas o hardware e o serviço de assinatura exigido podem ser caros, custando entre US $ 10.000 e US $ 100.000 para instalar e manter.

Mais escolas estão adotando sistemas de segurança de alta tecnologia, que dependem de vestibulos bloqueados, portas de acesso a cartões, gerenciamento de visitantes em rede e vigilância por vídeo.

“Tão importante quanto manter os intrusos fora de um prédio da escola, é como responder efetivamente para proteger os ocupantes do edifício, caso a ameaça ganhe entrada no prédio”, disse John LaPlaca, fundador e presidente do Altaris Consulting Group, uma consultoria especializada em segurança escolar e isso funcionou com o PikMyKid. “Tenha em mente que a história também demonstrou repetidamente que a ameaça pode estar legalmente em seu prédio, como foi o caso de atiradores de estudantes ou empregados”.

Para proteger as escolas de ameaças mais iminentes, as escolas também estão instalando sistemas de pânico eletrônico que podem manter os ocupantes automaticamente por trás de portas trancadas dentro de um prédio, afirmou LaPlaca em um e-mail. Além das aplicações de botões de pânico, as escolas também estão instalando sistemas de telefone VoIP que permitem aos membros da equipe implementar um bloqueio usando um código digitado se eles identificarem uma ameaça iminente.

Tais sistemas podem reproduzir automaticamente mensagens pré-gravadas sobre a construção de sistemas de PA, notificar a polícia, fechar e bloquear portas, ativar flashes no exterior do edifício e enviar mensagens de texto aos administradores escolares. Mas, afirmou LaPlaca, é importante lembrar que nenhum sistema pode ser completamente impermeável às ameaças. “A sombria realidade continua a ser que uma pessoa que está empenhada em entrar em uma escola irá fazê-lo com relativa facilidade, independentemente das medidas de segurança que estão no lugar”, disse ele.

Bhava é rápido para admitir que o maior problema é como parar os tiroteios antes de começarem. No momento, ele disse que o foco da PikMyKid é “tentar reagir a uma situação de maneira eficiente em termos de tempo”, mas a prevenção é o que queremos chegar. “Ajudar a prevenir disparos em tempo real” é onde vejo [aprendizado de máquina ] e AI sendo realmente útil, mas não nas ferramentas que realmente usamos para gerenciar e rastrear “.

Os dados e a inteligência artificial podem ajudar? O aprendizado de máquina pode usar os dados existentes para desenvolver algoritmos que revelam pontos comuns: por exemplo, compilando perfis de invasores, o aprendizado de máquina poderia nos dizer que ambos o Heath High School-shooter Michael Carneal e Sandy Hook-assassino Adam Lanza foram intimidados na escola. A AI poderia então fazer referência cruzada a este ponto comum com alunos atualmente intimidados, a fim de identificar quem poderia se tornar um atirador no futuro.

Claro, nem todas as crianças que são intimidadas se tornam um assassino em massa. E nem todos os assassinos em massa costumavam ser intimidados. O uso de tecnologia preditiva dessa maneira poderia estabelecer as bases para uma sociedade de Relatório de Minoria como um relatório. Além disso, os resultados de correspondência de padrões provavelmente estarão errados: não existe um fator único ou perfil universal para atiradores escolares, nenhuma raça comum, nenhum gênero único, nenhuma única dinâmica familiar que o AI pode bloquear. Mas isso não significa que os desenvolvedores de AI não possam procurar soluções nos dados que eles possuem.

Na PikMyKid, a maioria dos dados vem da geotracking. O recurso de inicialização do arranque atualmente cria uma geofence de 300-500 jardas em torno de escolas parceiras; É assim que os administradores sabem onde os pais estão estacionados. No futuro, Bhava disse: “Queremos dar aos administradores da escola acesso a feeds sociais abertamente disponíveis dentro da área de geografia em torno da escola – digamos 5 milhas em torno da escola – de qualquer hashtags que envolvam escolas e certas palavras-chave”.

Além do óbvio, como “bully” ou “arma”, palavras-chave e frases violentas são identificadas pelo processamento de linguagem natural (PNL), um tipo de AI que ensina aos computadores a entender e usar linguagem como pessoas. A API do Twitter torna mais fácil para os desenvolvedores acessar e monitorar tweets. Mas o idioma é complicado com múltiplos significados – então o processamento desses tweets é muito mais difícil. Pegue as letras da música, por exemplo, que geralmente aparecem nas postagens. “Eu consegui um bolso de balas e um modelo da escola” poderia ser o tweet de um futuro atirador, alguém citando o “Wicked Young Man” de Alice Cooper, ou ambos.

O Dr. Desmond Patton, diretor do Laboratório SAFE focado nas redes sociais da Universidade de Columbia, disse: “Nós usamos apenas as palavras como um dado, não a verdade. É realmente importante, particularmente quando falamos de mídias sociais e dados que vem de grupos marginalizados … A maneira como eles falam sobre si mesmos em suas comunidades é imediatamente considerada como arriscada ou ameaçadora, então fazemos muito trabalho para descompactar a narrativa por trás da narrativa. Então, se uma letra … parecer [agressiva para o olho inexperiente], fazemos muito trabalho para garantir que desembalhemos a verdadeira narrativa “.

Durante quatro anos, o SAFE Lab, uma iniciativa de pesquisa na Columbia School of Social Work, trabalhou com a PNL para entender melhor a linguagem da violência. Os críticos humanos no laboratório usam a máquina aprendendo a processar dois milhões de tweets postados por 9.000 jovens e membros de gangues em risco e tentam interpretá-los: como a mudança de idioma como um adolescente fica cada vez mais perto de se tornar violenta?

“O conteúdo problemático pode evoluir ao longo do tempo”, disse Patton. Em outras palavras, ninguém nasce um atirador. E talvez seja o que torna tão difícil para a AI prever quando alguém se tornará um: nenhum incidente movimenta uma pessoa de pleno potencial para assassino em massa durante a noite. O processo de se tornar um assassino é gradual e, ao longo do caminho, muitos em risco buscam ajuda.

Para identificar como os jovens comunicam essas mudanças em suas vidas, o SAFE Lab também analisa todas as fotos postadas com os tweets. Ao processar palavras e imagens em conjunto, Patton disse que o laboratório ultrapassa a simples análise do sentimento – um tipo de PNL que detecta se a linguagem é positiva ou negativa – para se concentrar em “a emoção real de uma imagem. É essa imagem sobre o sofrimento? Essa imagem é sobre ameaças? … Isso está em uma vizinhança? Isso está na rua? O que mais está acontecendo em uma imagem que nos ajuda a entender de forma mais complexa? “

À medida que os indicadores surgem, os revisores humanos do SAFE Lab observam os fluxos. Os dados que eles descobrem vão para cientistas da computação no Data Science Institute da Columbia, que a analisam quantitativamente, formando subconjuntos para treinar um mecanismo de aprendizado de máquina para reconhecer quando alguém está em seu ponto de ruptura. Caso o SAFE Lab identifique uma ameaça de violência nas mídias sociais, o laboratório pode notificar os trabalhadores sociais na cidade natal do usuário que estão habilitados a intervir.

Ao analisar as mídias sociais para a linguagem relacionada à violência, o algoritmo do SAFE Lab é 81,5% preciso quando testado contra dados de treinamento, disse Patton. Mas, mesmo com esses resultados, Patton está lenta em dizer que a AI irá pegar um tiro a cada um dos novos jogadores. “Eu acho que há um grande foco sobre o que a AI pode fazer”, disse ele. “O que aprendemos é que a IA não pode fazê-lo por si só, que a AI precisa de análise discursiva e textual para poder entender o contexto”.

Em outras palavras, mesmo quando plataformas como o PikMyKid integram alertas de palavras-chave, sem revisão humana, essas palavras-chave podem desencadear falsos alarmes. Ou, como Bhava menciona, a AI também pode encontrar tanta linguagem ameaçadora on-line que as autoridades podem ficar cansadas dos “atiradores” que estão lendo “.

Mas a AI também pode ajudar a mitigar esse problema, de acordo com Bhava. “É aí que vemos a AI e o idioma da máquina realmente vem e nos ajuda a analisar e estimular esses números e a reduzir falsos positivos de tal forma que os administradores realmente prestam atenção a esses”, afirmou. “Porque se você inundá-los com 20-50 mensagens todos os dias, ficam entorpecidos e ignoram as ameaças reais que estão surgindo”.

No curto prazo, os orçamentos escolares limitados e os altos custos da tecnologia significam que a proteção das escolas dos atiradores ativos pode depender menos de soluções tecnológicas e mais no planejamento básico, afirmou LaPlaca, consultora de segurança escolar.

“A tecnologia não é uma panacéia para criar uma escola mais segura”, disse ele. “Engajar-se em programas de prevenção e avaliação de ameaças, criar planos de emergência sólidos e realizar treinamento contínuo são a fruta de baixa suspensão que pode proporcionar retornos tremendos para investimento limitado ou nenhum. Muitas das oportunidades de melhoria mais eficazes não custam nada “.